Last updated on september 6th, 2024 at 03:02 pm

De data raakt op. Help! En data dat is de brandstof voor AI modellen. Online data, dus jouw artikelen en posts op internet. De berichten van experts en deskundigen die gewaardeerd worden en veel bezocht wordt, raakt op.

Verdwijnt dat dan of zoiets? Is er een Bermuda-driehoek of een zwart gat op internet gevonden? Is de Google zoekmachine stuk?

Voor het trainen van AI modellen als ChatGPT, Gemini en Claude wordt digitale data gebruikt.

En dan geldt: hoe meer data, hoe beter A.I. modellen werken. AI-modellen worden nauwkeuriger en menselijker worden met meer gegevens.

Hoe meer boeken, essays en andere informatie er wordt gelezen door mensen, hoe meer we weten, hoe meer we begrijpen en hoe beter we verbanden kunnen leggen. Dat geldt ook zo voor grote taalmodellen, de AI-systemen die de basis vormen van chatbots. Ze worden nauwkeuriger en krachtiger als ze meer gegevens krijgen.

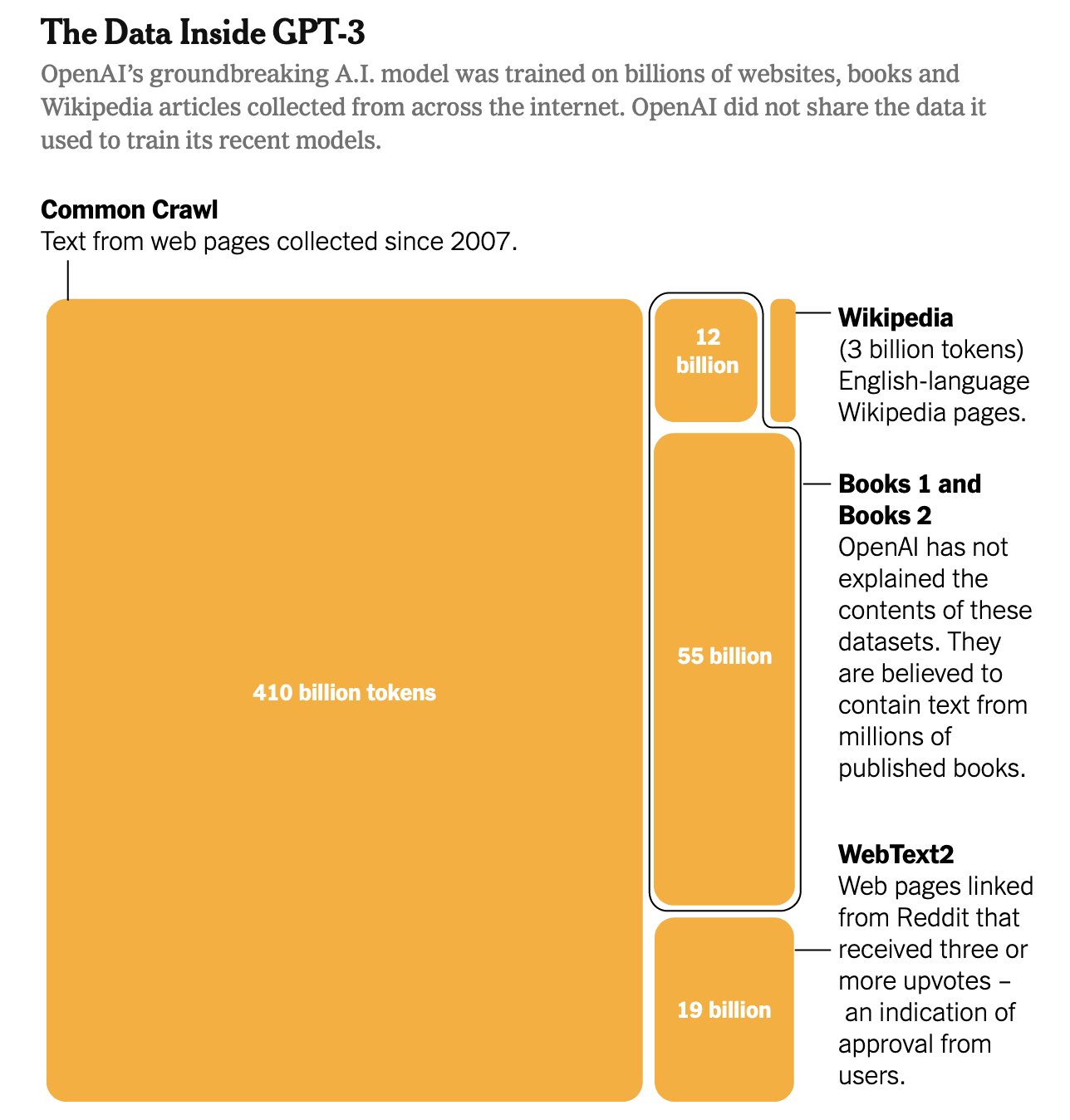

Sommige grote taalmodellen, zoals OpenAI's GPT-3 werden getraind op honderden miljarden ‘tokens’. Tokens zijn hele woorden of stukjes woorden. De meest nieuw AI modellen werden getraind op meer dan drie biljoen tokens.

Chat GPT-3 werd getraind op miljarden voornamelijk Engelstalige websites, boeken en Wikipedia-artikelen verzameld van het internet. Maar openbaar beschikbare online data om A.I.-modellen te ontwikkelen, wordt sneller opgebruikt dan nieuwe data wordt geproduceerd.

Digitale data van hoge kwaliteit zal in 2026 op zijn. ‘Van hoge kwaliteit’ betekent professionals en deskundigen hebben teksten geschreven, die andere deskundigen gecontroleerd hebben, citeren en hergebruiken om hun zienswijze te geven. Die data wordt dus doorgegeven aan elkaar.

Techbedrijven doen er alles aan om meer en nieuwe data te verkrijgen. De makers van ChatGPT (OpenAI) , Google (Gemini) en Meta (FaceBook) zoeken nieuwe manieren om data te verzamelen.

Ze veranderen hun gebruikersvoorwaarden zodat ze de data in de gratis versies bijvoorbeeld kunnen gebruiken.

Als er niet genoeg diamanten zijn, dan maak je er zelf eentje in een laboratorium. Dat heet dan een 'synthetische diamant'. Kun je er toch geld mee verdienen.

Bij data kunnen we ook overschakelen op 'synthetische' data. Data gemaakt door een AI model en daarmee andere AI’s gaan trainen. Synthetische data is riskant omdat A.I.-modellen fouten kunnen maken. Dat heet dan geen liegen maar hallucineren. Alleen jij en ik weet dan dat de informatie niet klopt, maar hoe kan de AI dat doen? Anders blijft die foute data overal in doorwerken.

De data voor AI raakt op. Nou nee, wij zullen daar in het gewone leven niets van merken. Niet direct tenminste. En toch kan het veel invloed hebben.

Erg? Wat is erg? Als je als bedrijf miljarden hebt geïnvesteerd in AI modellen en ze dus niet meer kan trainen…… tsja, dan ben je niet blij. De vrij beschikbare data is op; die zit er in.

Het lijkt een beetje op het gedoe rond die populaire serie Game Of Thrones. De schrijver liep op een gegeven moment achter met het schrijven van boeken op de snelle productie van de tv-serie. En we weten dat de kwaliteit van het laatste seizoen tegen viel.

Als je student bent en je wilt studeren maar je hebt Jip en Janneke al uit, en de Wikipedia ook al en je moet even wachten op nieuwe boeken, want die zijn nog niet door de firma Bol verstuurd. Dan kun je je nog niet verder ontwikkelen.

Techbedrijven doen dan twee dingen: ze rekken de gebruiks-voorwaarden op en stellen dat ze nu jouw data wel mogen gebruiken, en ze laten AI zelf data maken.

Ik vind beide oplossingen eigenlijk geen oplossingen en dus ‘erg’. Eerst werd er gezegd dat we onze privacy moesten opgeven om zo het gebruik van sociale media gratis te houden. We betaalden met onze privacy.

Je zocht op internet naar hardloopschoenen en bleef je advertenties zien van hardloopschoenen, te pas en te onpas.

Daarna zeiden techbedrijven: gebruik onze gratis mailservers, zet daar naast je email ook lekker jouw foto’s op en je documenten. Wij passen wel op. En nu zeggen de techreuzen: o ja, onze AI moet getraind worden dus wij rekken onze gebruiksvoorwaarden op. Wij kunnen jouw data gebruiken voor het trainen van onze AI.

De spelregels worden tijdens de wedstrijd gewijzigd.

Net zoals synthetische diamanten, laten techbedrijven nu AI teksten maken die dan aan andere AI’s al trainingsmateriaal wordt gegeven. .

En wie gaat die teksten dan controleren op juistheid. Zijn ze nog van hoge kwaliteit? Zijn ze betrouwbaar? het gaat straks allemaal onderdeel van de door ons gelezen tekst worden.

Wat te denken van techbedrijven die uitgevers opkopen om zo de boekteksten van schrijvers in handen te krijgen en die te digitaliseren? Krijg je dan dat diezelfde schrijvers straks concurrentie ondervinden van zichzelf omdat AI boeken schrijft in de kenmerkende stijl van die schrijver? Kan die uitgever nog boeken schrijven die kritisch zijn over AI?

Zoveel vragen, zo weinig zekerheden. Ik start even ChatGPT op. Die zal het vast wel weten.